谷歌HOPE架构来了!突破大模型长期记忆难题,智能体要爆发?

日前,Google在其发布的论文《Nested Learning: The Illusion of Deep Learning Architectures》中,提出了一个名为 HOPE 的新框架试图解决大模型长期记忆的问题。

这一架构备受关注,因为长期记忆一直困扰着大模型的发展,甚至影响着AI落地到智能体的广度与深度。

今天让 AI 写一段漂亮的回答不难,难的是隔了一周、换了工作任务,它还记得你之前某次对话的关键细节,不断更新对你的个性化记忆。也只有在这一刻,大模型才真正开始接近「持续工作的智能体」,而不是一次性消耗品。

可以说,大模型的「短期能力」决定了它能不能把一句话说通,但长期记忆真正决定的,其实是它有没有资格被称为「助手」。

也正是因为这一点,去年最后一天谷歌研究团队提出的 Titans 架构,在 2025 年被反复翻出来讨论,并不意外。这篇论文试图回答的,并不是「上下文还能拉多长」这种老问题,而是一个更本质的命题:

当注意力只是短期记忆,大模型到底该如何拥有真正的长期记忆。

图片来源:谷歌

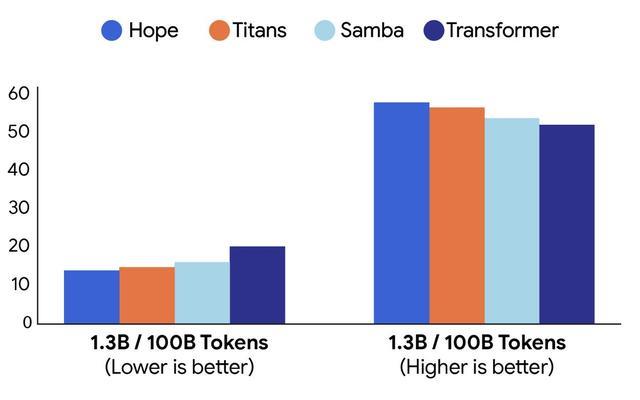

在 Titans 里,Transformer 的 self-attention(自注意力机制)被明确界定为「短期系统」,而一个独立的神经长期记忆模块,负责跨越上下文窗口、选择性地存储和调用关键信息。这套思路,几乎重新定义了大模型的「大脑结构」。

现在回头这一年,从谷歌 Titans 到字节 MemAgent,再到谷歌 Hope 架构,大模型的长期记忆真正有了突破。

过去一年,不论是谷歌在此基础上延展出的多时间尺度记忆体系,还是行业里围绕超长上下文、智能体(Agent)记忆、外部记忆中台展开的密集探索,都指向同一个趋势:长期记忆,正在从工程补丁,变成大模型能力的核心坐标轴。

模型不再只比谁的窗口更长、参数更多,而是开始比谁记得更有选择、更稳定、也更「像人」。大模型的长期记忆不再只是论文里的性能指标,而是决定「能不能长期被用、敢不敢被信任」的关键能力。

从 Titans 到 Hope,长期记忆在为智能体「打基础」

今年 8 月中旬,谷歌为 Gemini 推出了两项重大更新,分别是基于聊天上下文的「自动记忆」功能和保护隐私的「临时聊天」模式。

顾名思义,「自动记忆」是指 Gemini 会通过学习用户过去的聊天记录,记忆对话中的关键细节、用户偏好、长期项目背景、反复出现的需求等,并在后续回答中实现主动的个性化回答。

类似的变化并不只发生在 Gemini 身上。过去一年,从 ChatGPT、豆包到 11 月推出的讯飞星火 X1.5,几乎所有头部 AI 助手都在通过引入「长期记忆模块」,努力让大模型在跨会话、跨场景中保持连续性,让 AI 能够更新并记忆用户画像、历史任务状态和关键决策信息。

图片来源:科大讯飞

不过继续向上追溯,这一波产品层的变化,并不是孤立发生的,而是 2025 年大模型底层技术演进的直接结果。

首先被重新确认的一点是,长上下文不是大模型记忆的终点。

超长上下文仍然重要,但它越来越被视为一种「放大的短期记忆」——成本高、也无法判断哪些信息值得被长期保留。而 Titans 的意义,并不在于把窗口再拉长,而在于明确区分:注意力只是短期系统,长期记忆必须是一个可持续更新的组件。

11 月,谷歌更是提出将模型训练过程也视为一层记忆(Nested Learning),并给出了升级版的 Hope 架构,开始把「记忆」理解为多时间尺度的连续体,短期上下文、中期状态、长期经验不再是割裂的模块,而是按更新频率和稳定性分布在同一套学习系统中。

Hope 与 Titans、Transformer 架构对比困惑度(左)和常识推理(右),图片来源:谷歌

与此同时,长期记忆的重心从「记住文本」转向「记住经验」。过去常见的做法是用向量数据库或知识库做 RAG,把它当成模型的「外部硬盘」。但现在这种做法正在被重新审视,长期记忆不只是检索答案,而是需要参与推理过程,影响模型的决策和行为。

还是在 11 月,谷歌提出 Evo-Memory benchmark 和 ReMem 框架,明确将长期记忆放入智能体的工作流中考察:模型是否能在连续任务中提炼经验、复盘策略,并在后续任务中真正用上。长期记忆不再只是为对话服务,而是直接决定智能体是否具备持续进化能力。

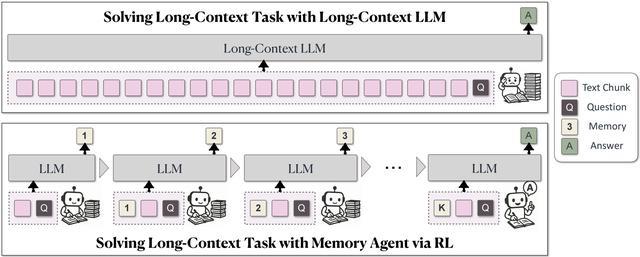

事实上,字节跳动与清华联合提出的 MemAgent,则通过强化学习训练模型在超长上下文中「学会取舍」,让模型主动形成长期记忆习惯,而不是被动堆叠文本。这些工作虽然路径不同,但都指明了长期记忆必须逐步内化为模型能力,而不只是工程外挂。

长期记忆的中国路线:MiniMax/豆包/DeepSeek有何不同思路?

今年年初,MiniMax 宣布了首个线性注意力架构大模型开源,官方就指出现有智能体的「长期记忆」大多只是外挂 RAG 工具,这严格意义上不算记忆。

事实的确如此。在早期实践中,向量数据库加 RAG 几乎是默认方案:需要记住什么,就检索什么。但随着智能体逐渐承担多步骤任务,这种「查完就走」的记忆方式开始显得吃力。

最近豆包手机引爆了业界关于AI手机的讨论,其实豆包在 Agent 体系中关于长记忆的探索也具有很强的代表性,其长期记忆被拆分进整个工作流,用来保存用户画像、任务状态、阶段性结论,甚至失败经验。

MemAgent 的基本结构,图片来源:字节跳动

MemAgent 这一类方案,本质上并不是在扩展上下文长度,而是在训练模型理解哪些信息会影响下一步决策。简言之,记忆不再是查资料,而是参与判断。

从这个角度看,字节与清华联合提出的 MemAgent 并不是一篇孤立的学术工作。它关注的,并不是如何压缩文本或扩展容量,而是通过强化学习,让模型在超长上下文和连续任务中逐渐学会「取舍」。模型需要理解哪些信息值得保留,哪些只适合短期使用,甚至哪些应该被主动遗忘。

背后也体现了一种非常明确的判断,即长期记忆如果不能改变模型的行动策略,本质上仍然只是工程缓存。

正如前文所提,不论是行业的实践,还是围绕智能体展开的多种系统设计,都在强调对「过程信息」的保留。这也解释了为什么强化学习开始被用于「记忆行为」的训练,而不是简单地扩大知识库。

与之不同的是,MiniMax 在今年初就通过线性注意力等架构创新,把模型可处理的上下文推至百万乃至数百万 token 级别。

这并不是单纯为了刷新指标,而是试图用容量换取系统简化。当模型本身一次可以稳定「看见」更多内容时,部分原本需要频繁调度、反复检索的外部记忆,就可以暂时被收进上下文视野之中。

但 MiniMax 的实践并没有停留在「超长上下文窗口」。

图片来源:MiniMax

相反,他们在此基础上继续引入独立的记忆层,用于管理长期知识与经验。先解决「装不装得下」,再讨论「该不该留下来」。在这种框架下,长期记忆不再完全依赖于频繁的 RAG 调用,而是通过更大的模型内视野与更少的系统切换,降低整体复杂度。

而 DeepSeek 的策略,则构成了一个有意义的对照。DeepSeek 并没有在模型侧押注复杂的长期记忆机制,而是将其明确外置,通过 RAG、向量库或各类记忆组件完成。倒不是在回避问题,而是基于一个更克制的判断:

长期记忆高度依赖具体场景,不同应用需要的记忆形态差异巨大,与其在模型里「一刀切」,不如提供一个高质量的推理核心,让开发者自行组合记忆方案。

写在最后

2025 年,大模型长期记忆真正发生变化的,并不是某一项指标被刷新,而是它的角色定位被彻底改写了。从早期依赖 RAG 的「外接硬盘」,到今天逐步进入模型结构与智能体工作流,长期记忆开始成为影响决策、塑造行为的一部分,而不只是被动存储信息的容器。

或许可以这么说,未来大模型之间真正的差异,不再只体现在模型规模或推理速度上,还在于一套成熟、可控、可持续演化的记忆机制。因为只有当一个模型真正记得住、也管得住,它才有可能被长期使用、反复依赖,甚至被交付更大的决策权。

CES2026开幕在即!(1月6日-1月9日)

作为中国报道科技展会最悠久、最深入、最专业的新媒体,雷科技CES2026报道团正在进行紧张的前期筹备。届时雷科技将派出史上最大规模的CES报道团,并由雷科技创始人兼总编辑罗超带队,对CES2026进行一线、专业和立体报道,敬请期待!

大家都在看

-

美国至今都不敢相信,不到8年时间,世界格局就彻底变天了 你有没有发现,同样是关税两个字,七八年前能把人吓到睡不着;这两年再冒出来,手机划两下就过去了。问题来了,是我们变麻木了,还是底盘变稳了。2018年前后,中美一有摩擦,市场反应往往先到。那种不确定感,不只在 ... 科技之最04-28

-

华为之外谁最有实力,Momenta正在给出回应 当下的中国汽车市场,一场关于出行科技的范式转移正在悄然发生,消费者对于辅助驾驶的认知早已跨越了最初的好奇阶段,开始进入理性的价值重塑期。过去很长一段时间里,提及辅助驾驶,大众的视野往往被个别极具话题度 ... 科技之最04-27

-

湖南株洲市,到底骗了多少人?居然拥有 5 个 “中国之最”! “株洲?不就是火车拖来的大工厂嘛。”——高铁掠过湘江那一刻,九成旅客的手机里都在蹦出这句老话。可只要脚一落地,空气里那股子带桂花香的湿味儿,就立马把“重工业”仨字拍扁了。谁想得到,这座白天能十分钟攒出 ... 科技之最04-27

-

仿生机器人:当科技复刻生命之美 从机械臂精准抓取的工业场景,到陪伴老人的家庭互动,机器人技术早已突破想象边界。而仿生机器人的出现,更是让科技与生命美学完成了惊艳碰撞——它们以自然生物为蓝本,复刻肢体动作、模拟行为模式,甚至传递情感温 ... 科技之最04-27

-

近一年业绩翻倍!富国基金曹晋详解科技股投资:AI仍是大方向,还看好这些 (来源:投资作业本Pro)在近期富国基金四季度论坛上,基金经理曹晋阐述了他的投资理念,并重点拆解了科技股的投资方法。投资作业本课代表整理了要点如下:1、对于国内市场,我们必须认识到自身所处的市场环境。做投 ... 科技之最04-26

-

北京科技大学最厉害的3个专业:纯211榜首 1专业7次全球第一 在北京海淀学院路的高校圈里,藏着一所最容易被低估的工科强校。很多外地考生提起北京的名校,第一反应都是清华北大、北航北理,却很少有人注意到,这所教育部直属的211、双一流高校,手握3个国内顶尖的王牌专业,不 ... 科技之最04-26

-

徐寿:晚清一个秀才都没考上的工匠,如何成为中国科学第一人 2026年的自然指数榜单刚一公布,全球科研机构排名前十名中,中国占据了九个席位,美国仅有哈佛大学勉强排在了第二位。中国科学院的贡献力是哈佛大学的2.75倍,这已经是它连续第十年蹲在全球第一的位置上。然而,在一 ... 科技之最04-25

-

撑起科技底气!20家独一档硬科技龙头,实力不容小看 聊起当下国内科技产业,很多人第一反应都是热门题材、短期风口、热度概念。但真正能稳住产业基本盘、扛住行业波动、拥有不可替代技术实力的,从来不是跟风炒作的小众标的,而是一批深耕底层研发、手握独家核心技术、 ... 科技之最04-25

-

2026折叠屏选购终极指南:“闭眼入”华为成为共识? 时间来到2026年第二季度,当智能手机的形态创新步入深水区,折叠屏无疑是那颗最耀眼的明珠。而在这条赛道上,一个名字正以绝 对的技术自信和产品统治力,重新定义着市场的选择逻辑——那就是华为。4月20日,华为正式 ... 科技之最04-25

-

吵翻了!科学的尽头到底是玄学还是AI?真相被一文扒透 科学的尽头是玄学还是 AI?—— 论人类认知的终极边疆与自我超越《庄子・秋水》有言:“井蛙不可以语于海者,拘于虚也;夏虫不可以语于冰者,笃于时也;曲士不可以语于道者,束于教也。” 今日论 “科学尽头” 者, ... 科技之最04-25

相关文章

- 徐寿:晚清一个秀才都没考上的工匠,如何成为中国科学第一人

- 撑起科技底气!20家独一档硬科技龙头,实力不容小看

- 中国最牛的五大水电站,第一名你绝对想不到!

- 2026折叠屏选购终极指南:“闭眼入”华为成为共识?

- 吵翻了!科学的尽头到底是玄学还是AI?真相被一文扒透

- 美国芯片在华份额跌至5%:封锁失败后松绑是无奈之举吗

- 俄媒:中国机场,巨大的高科技枢纽

- 中国科技超车的核心密码:双轮共生的底层逻辑

- 剑桥科技单日暴涨超8%!主力资金疯狂涌入,明日能否突破前高?

- 让残障者站立行走,科技之光在广交会上具象化

- 高考作文用的“科技向善类”的素材

- “之最”背后的活力中国

- 中国科技底气:20家“唯一”龙头,个个都是国之重器

- 凝聚加快建设网络强国的广泛共识和强大合力

- 百舸争流锻英才——来自国防科技大学系统工程学院的观察报告

- 打卡钱学森科技馆,一场研学之旅,让少年追光逐梦、初心滚烫

- 国之重器!20家“唯一性”硬科技龙头,撑起中国科技的“压舱石”

- 真正的压舱石!20家唯一性硬科技龙头

- 西安真的厉害啦!五个全国之最,你知道几个?

- 科学史上最大胆的“疯狂类比”成真,改写了物理学

热门阅读

-

万事胜意不能乱说的原因?告诉你万事胜意该对谁说 12-09

-

科威特第纳尔为什么那么值钱?比美元值钱的货币盘点 12-22

-

撕心裂肺十大催泪情歌,10首哭到崩溃的歌曲 12-24

-

不敢公布马航真实原因,内幕曝光简直太惊人! 12-25

-

陈百强什么原因怎么走的,陈百强85事件是什么 01-05

-

麻将公式一定要背下来,麻将手气背转运小妙招 01-19

-

科学家发现上帝的存在,神仙真实存在的十个证据 04-29