GPU时代终结?世界最大芯片加持推理狂飙20倍英伟达H100也被干趴

编辑:桃子 好困

【新智元导读】LLM若以每秒1000+token高速推理,当前最先进的GPU根本无法实现!Cerebras Inference一出世,推理速度赶超英伟达GPU,背靠自研的世界最大芯片加持。而且,还将推理价格打了下来。

LLM若想高速推理,现如今,连GPU都无法满足了?

曾造出世界最大芯片公司Cerebras,刚刚发布了全球最快的AI推理架构——Cerebras Inference。

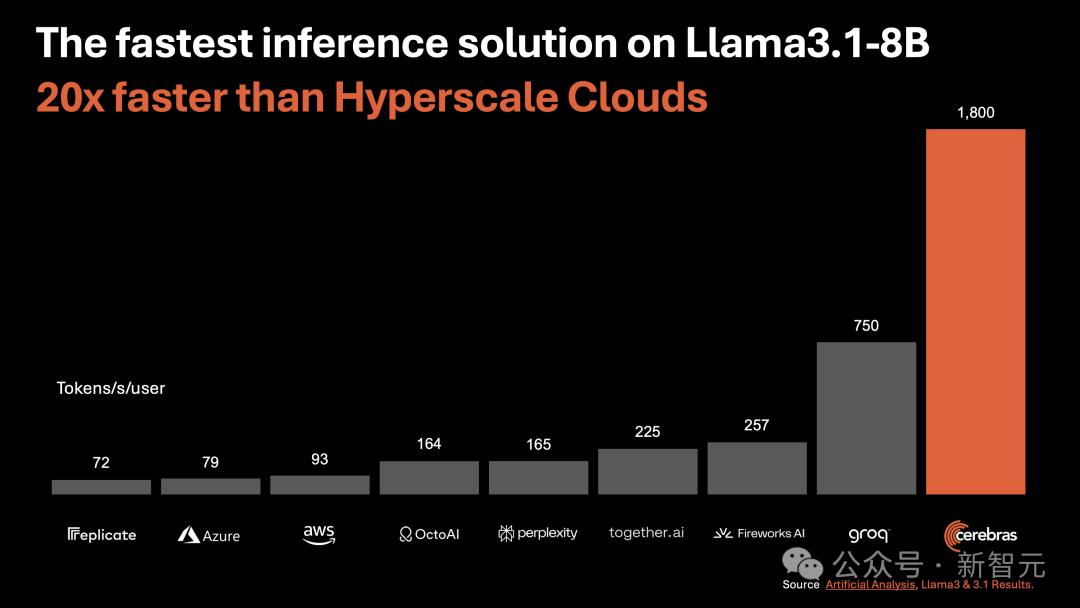

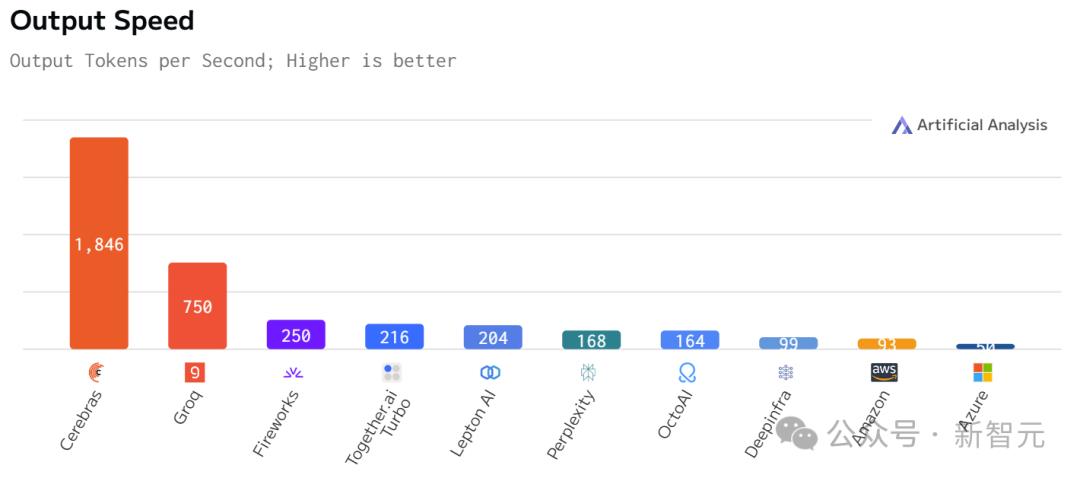

运行Llama3.1 8B时,它能以1800 token/s的速率吐出文字。

不论是总结文档,还是代码生成等任务,响应几乎一闪而过,快到让你不敢相信自己的眼睛。

如下图右所示,以往,微调版Llama3.1 8B推理速度为90 token/s,清晰可见每行文字。

而现在,直接从90 token/s跃升到1800 token/s,相当于从拨号上网迈入了带宽时代。

左边Cerebras Inference下模型的推理速度,只能用「瞬间」、「疯狂」两字形容。

这是什么概念?

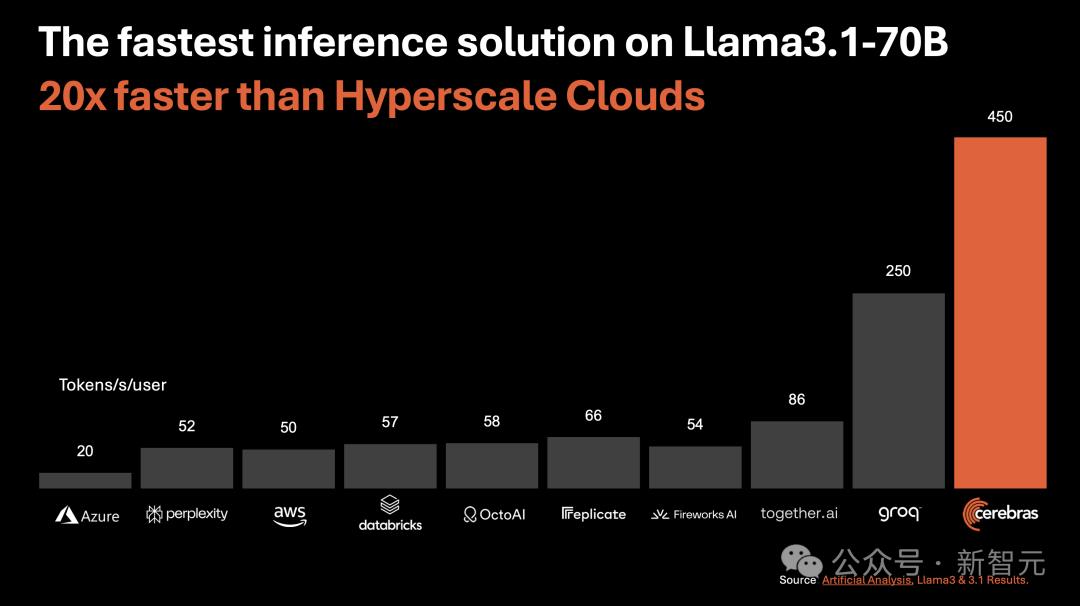

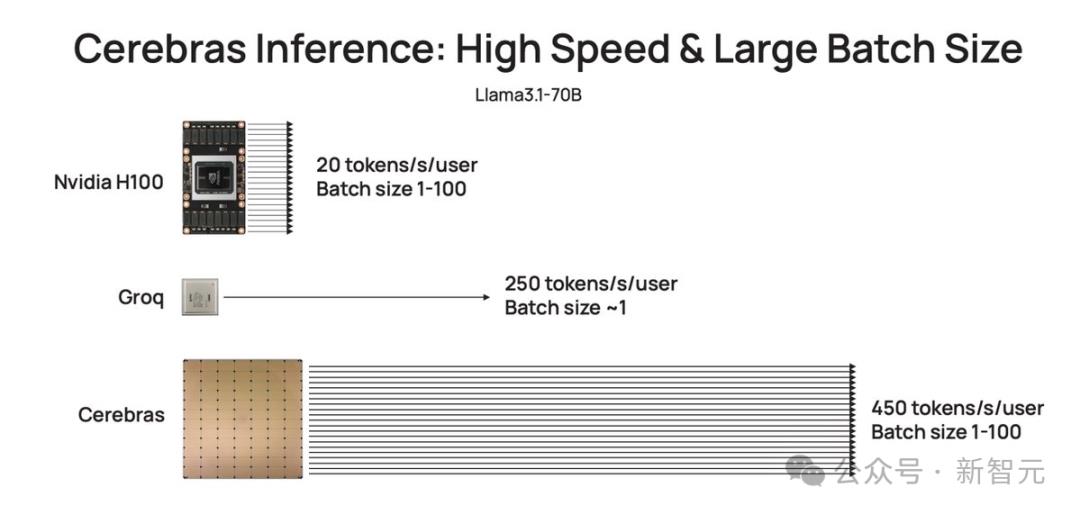

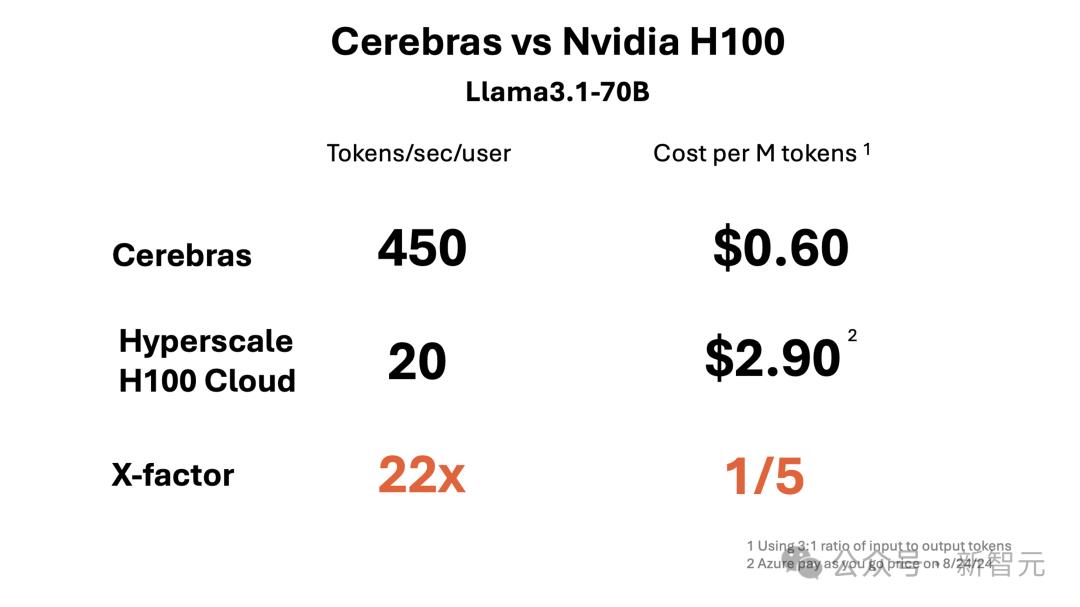

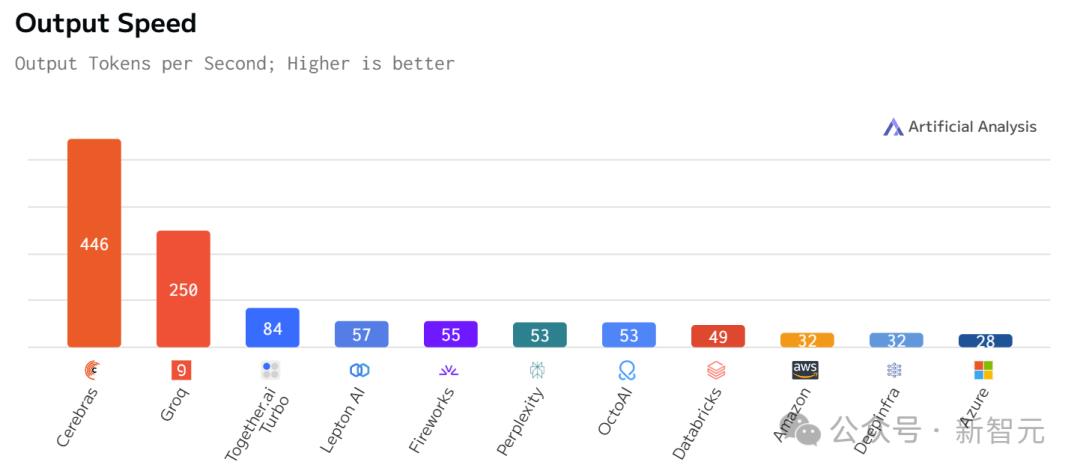

比起英伟达GPU,Cerebras Inference的推理速度快20倍,还要比专用Groq芯片还要快2.4倍。

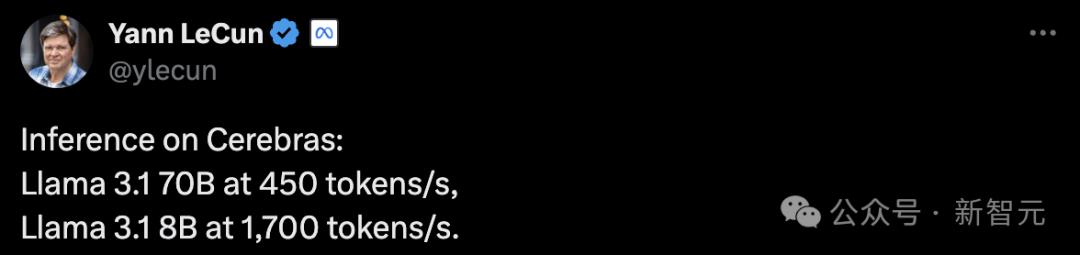

另外,对于70B参数的Llama3.1,可达到450 token/s及时响应。

值得一提的是,Cerebras并没有因为提高LLM的速度,而损失其精度。

测试中,使用的Llama3.1模型皆是采用了Meta原始16位权重,以便确保响应高精度。

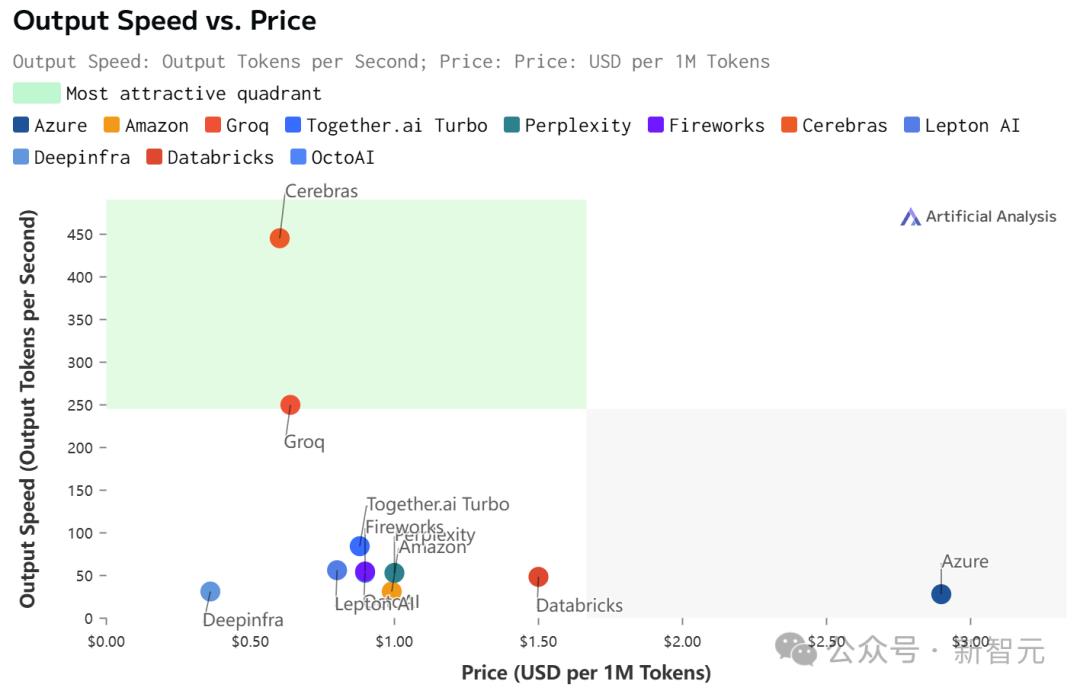

最关键的是,价格还实惠。

根据官方API定价,Llama 3.1 8B每百万token仅需10美分,Llama 3 70B每百万token仅需60美分。

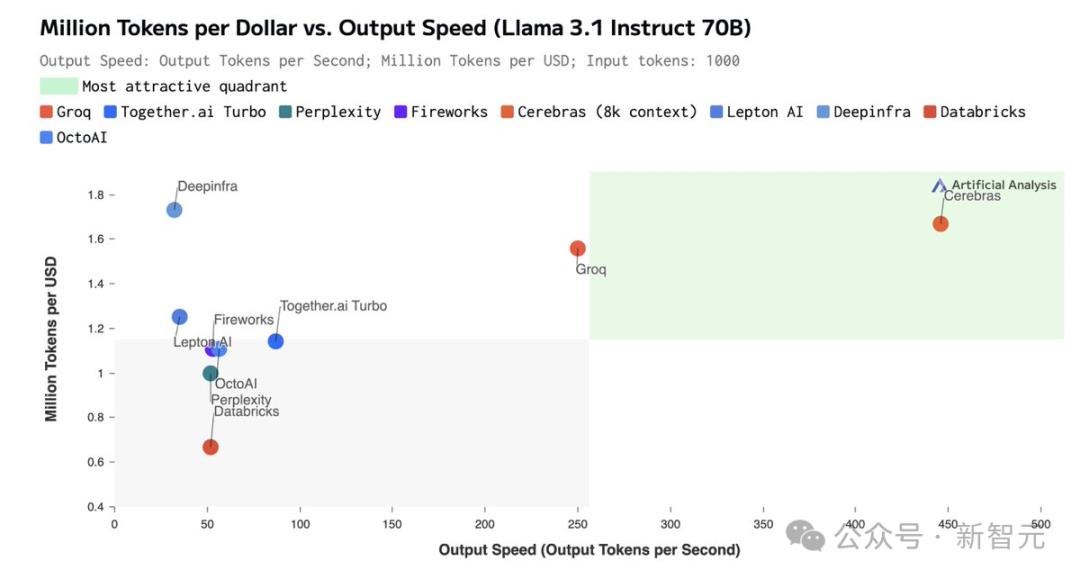

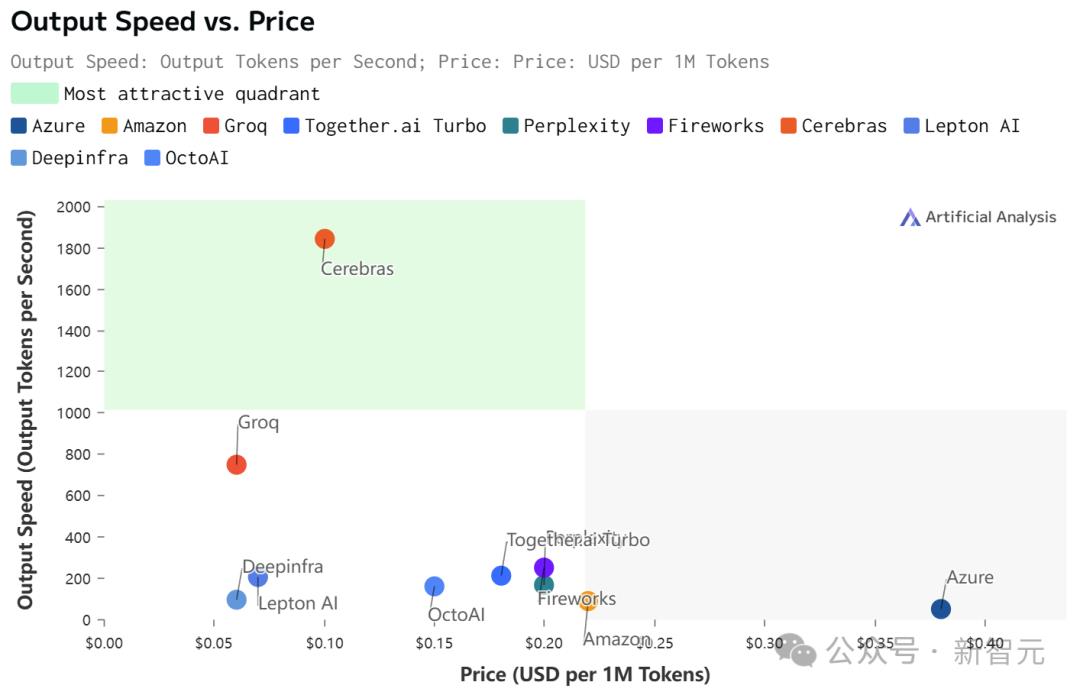

如此之高的性价比,更是打破了业界纪录——

不仅远超之前的保持者Groq,而且和其他平台相比,甚至是隔「坐标轴」相望了。

Artificial Analysis

正是因为Cerebras Inference背后,是由自研的第三代芯片Wafer Scale Engine助力,才得以1/5价格快速推理Llama3.1。

看到自家模型推理如此神速,LeCun、Pytorch之父纷纷动手转发起来。

还有网友看后表示,我想要!

推理很慢,英伟达GPU也不中用?

为什么LLM的响应,就像拨号上网加载网页一样,一个字一个字慢慢地吐出?

关键原因所在,大模型自身的顺序特性,以及需要大量的GPU内存和带宽。

由于GPU的内存带宽限制,如今推理速度为每秒几十个token,而不是数千个。

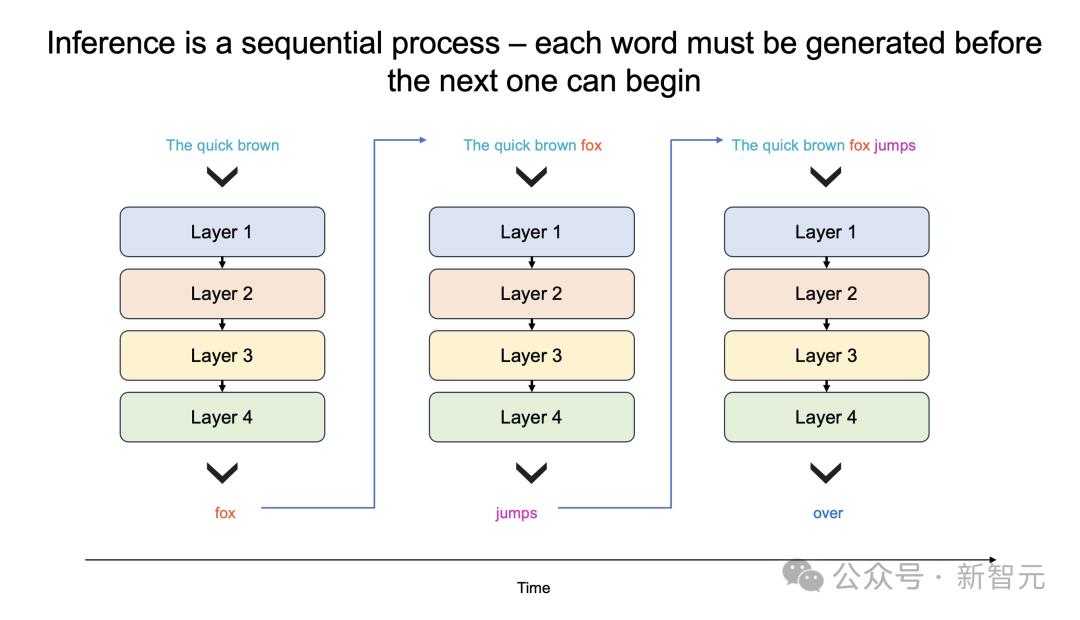

更进一步说,大模型每个生成的单词,都必须通过整个模型进行处理,即所有参数必须从内存投入到计算中。

而每生成一个单词,就需要一次处理,以此循环往复。

也就是,生成100个单词需要100次处理,因为「下一词」的预测,皆需要依赖前一个单词,而且这个过程无法并行。

那么,想要每秒生成100个单词,就需要所有模型参数,每秒投入计算100次。

由此,这对GPU内存带宽提出了高要求。

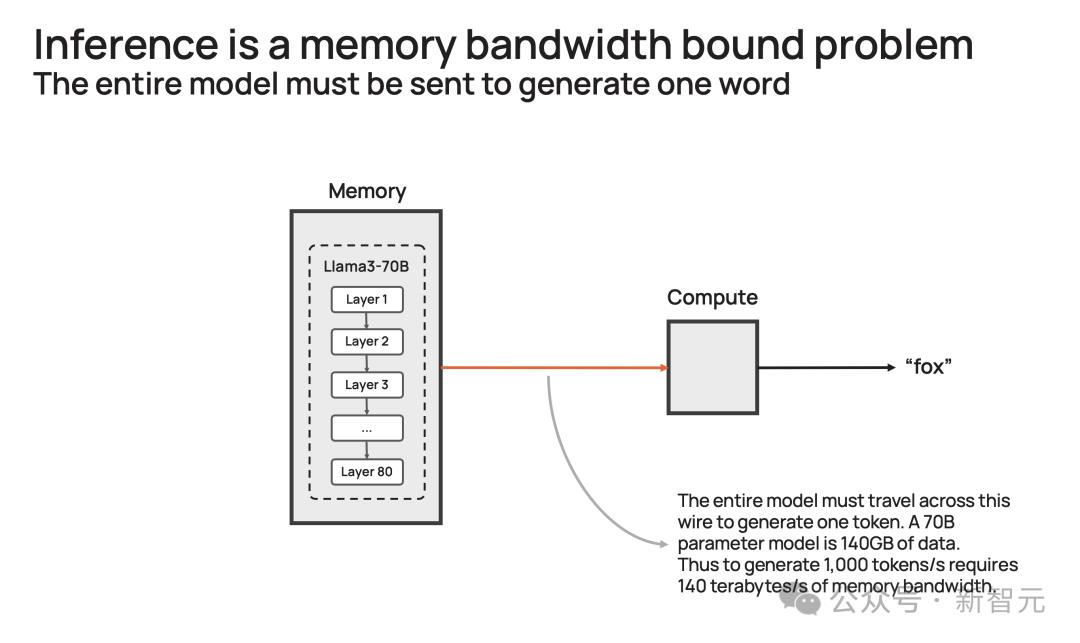

以社区流行的Llama3.1-70B模型为例。

模型有700亿参数,每个参数是16位,需要2字节的存储,那整个模型便需要140GB的内存。

想要模型输出一个token,那700亿参数必须从内存,移动到计算核心,以执行前向推理计算。

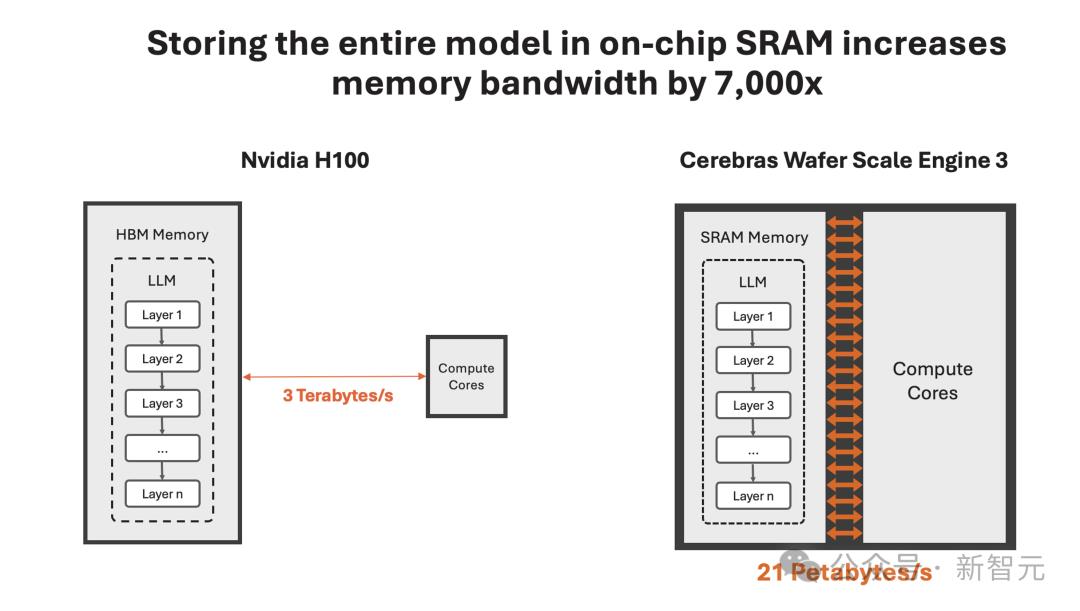

由于GPU只有约200MB的片上内存,模型无法存储在芯片。

因此,每次生成的token输出时,需将整个占用140GB内存的模型,完整传输到计算中。

再细算下来,为了实现10 token/s,则需要10*140=1.4 TB/s的内存带宽。

那么,一个H100有3.3 TB/s的内存带宽,足以支持这种缓慢的推理。

而若要实现即时推理,需要达到1000 token/s或140 TB/s,这远远超过任何GPU服务器/系统内存带宽。

或许,你想到了一种「暴力」解决方案,将多个GPU串联搭建DGX系统。

这完全是大错特错,更多的处理器只会增加系统的吞吐量(给出更长响应),并不会加速单个查询的响应时间。

自研世界最大芯片,打破推理想象

那么,Cerebras如何打破这一困局呢?

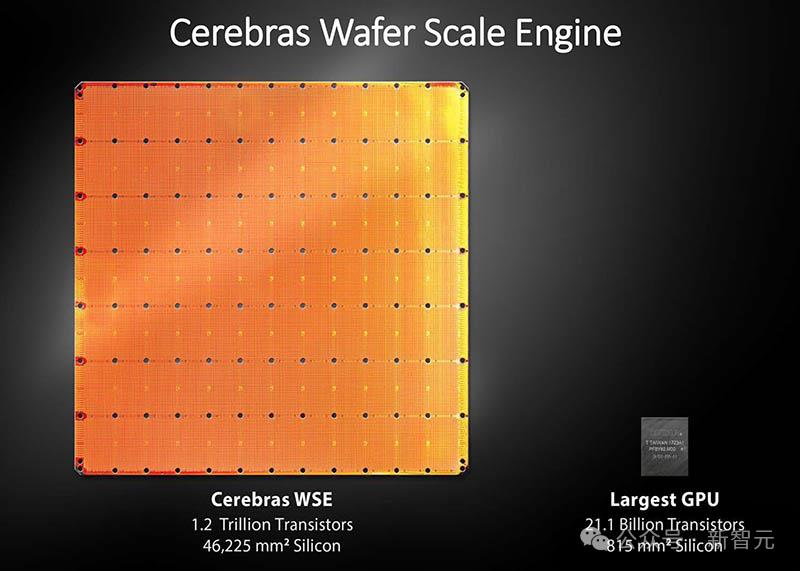

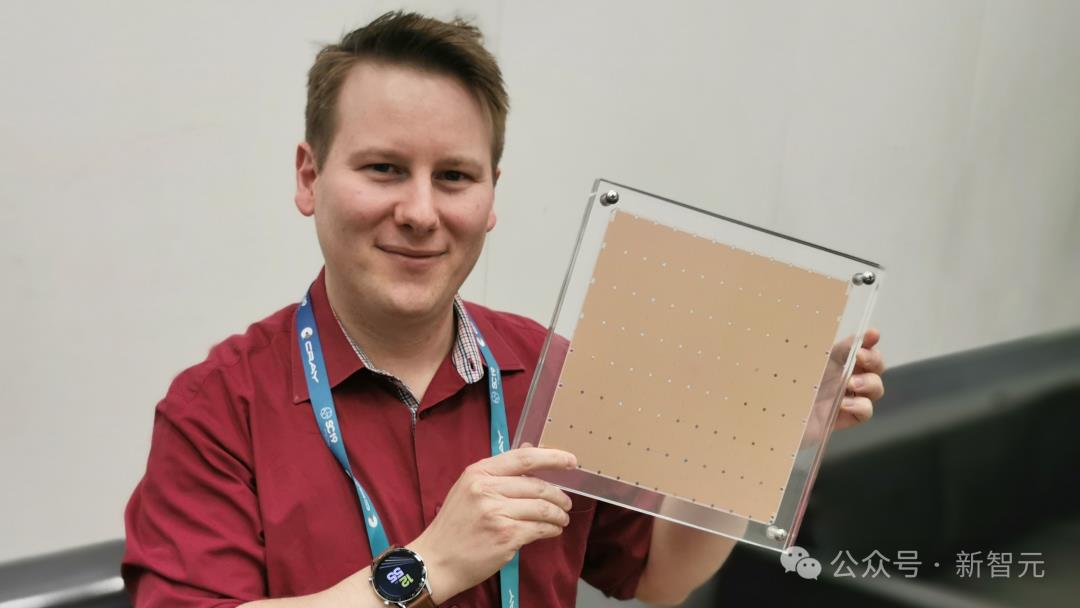

一直以来,这家公司就致力于打造世界上最大芯片,希望将整个模型存储在一个晶片上,以此来解决内存带宽瓶颈。

凭借独特的晶圆设计,WSE-3单个芯片上便集成了44GB SRAM,具备21 PB/s的内存带宽。

单个芯片拥有如此大内存,便消除了对外部内存的需求,以及将外部内存连接到计算的慢速通道。

总的来说,WSE-3的总内存带宽为21PB/s,是H100的7000倍。

它是唯一一款同时具有PB级计算和PB级内存带宽的AI芯片,使其成为高速推理的近乎理想设计。

Cerebras推理不仅速度超快,而且吞吐量巨大。

与小型AI芯片相比,芯片上内存多了约200倍,支持从1-100的批大小,使其在大规模部署时,具有极高的成本效益。

正是有了如此强大的芯片,Cerebras Inference的快速推理得以实现。

它的出现,是为了实现数十亿到万亿参数模型的推理。

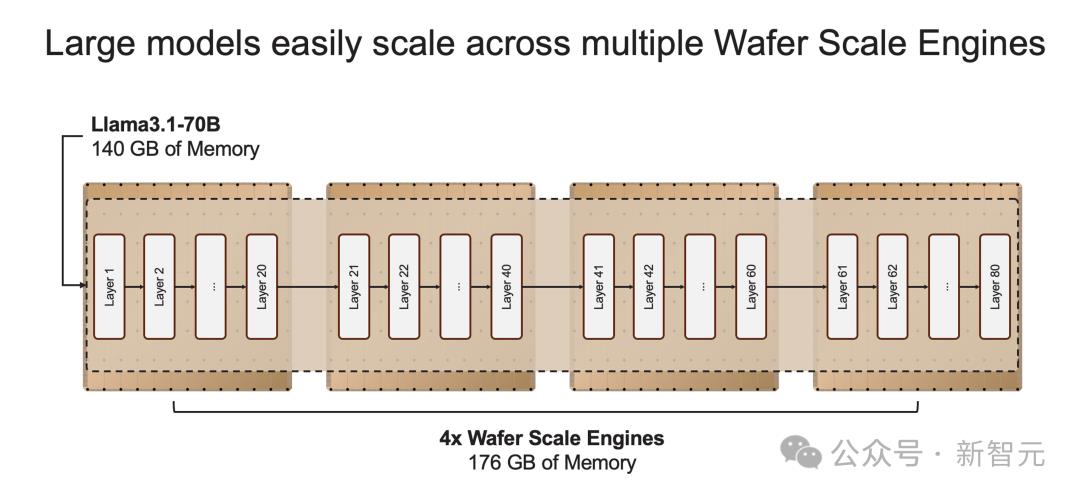

如果模型参数超过单个晶圆的内存容量时,研究人员将在「层边界」将其拆分,并映射到多个CS-3系统上。

20B模型适合单个CS-3,而70B模型则至少需要4个这样的系统。

官方表示,未来几周,将会测试更大参数版本的模型,比如Llama3-405B、Mistral Large。

16位精度,不做取舍

推理速率高,并非在模型权重上,做了取舍。

业界中,一些公司试图将模型权重精度,从16位减少到8位,来克服内存带宽的瓶颈。

这样方法,通常会造成模型精度损失,也就是响应结果的准确性、可靠性不如以前。

Cerebras Inference之所以强就强在了,速率和原始权重,皆要顾及。

正如开篇所述,他们采用了原始16位权重运行了Llama3.1 8B和70B。

通过评估,16位模型准确率比8位模型,高出多达5%。尤其是在,多轮对话、数学和推理任务中表现更好。

最优性价比,百万token免费送

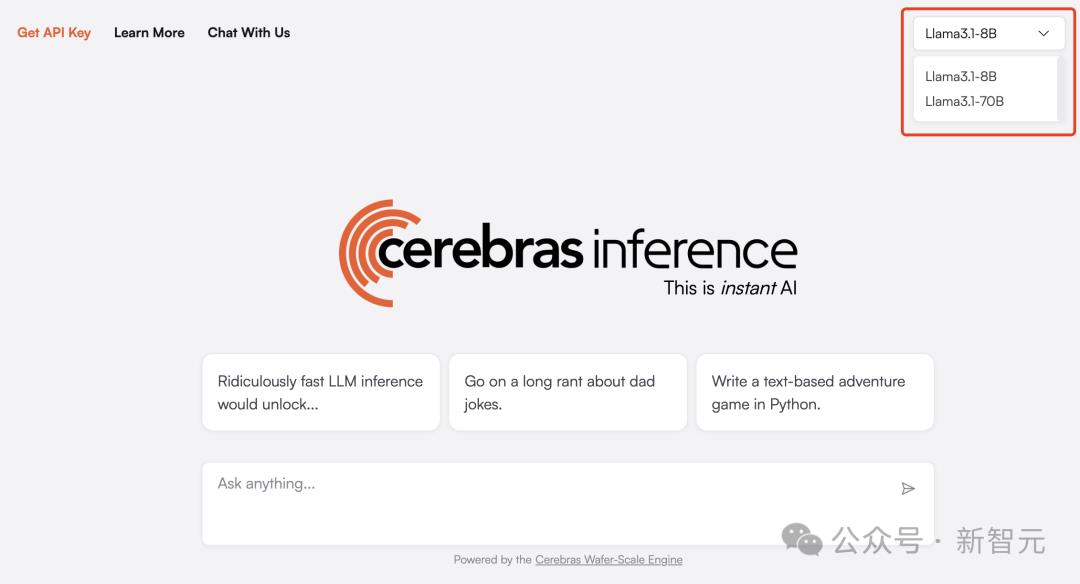

目前,Cerebras Inference可通过聊天平台,以及API访问,任何一个人可随时体验。

体验传送门:https://cerebras.ai/blog/introducing-cerebras-inference-ai-at-instant-speed

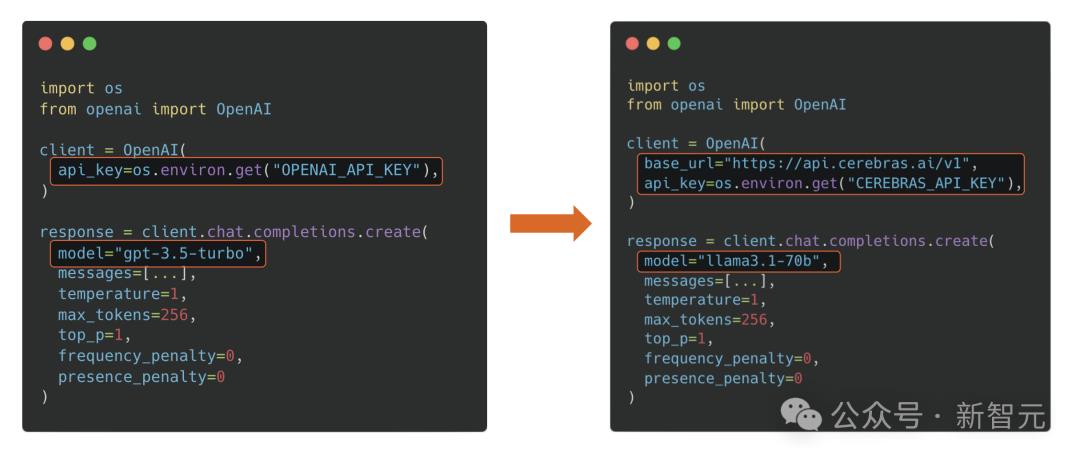

基于熟悉的OpenAI Chat Completions格式,开发者只需更换API密钥即可集成强大的推理功能。

Cerebras Inference API提供最佳的性能、速度、精度和成本组合。

它是唯一能即时运行Llama3.1-70B的方案,可实现450 token/s,同样使用的是原始16位模型权重。

在此,Cerebras送上大福利,每天为开发者们提供100万个免费token。对于大规模部署,其定价只是H100云的一小部分。

首次推出时,Cerebras提供了Llama3.1 8B和70B模型,而且有能力每天为开发者和企业,提供数千亿token。

接下来几周,他们将增加对更大模型的支持,如Llama3 405B、Mistral Large 2。

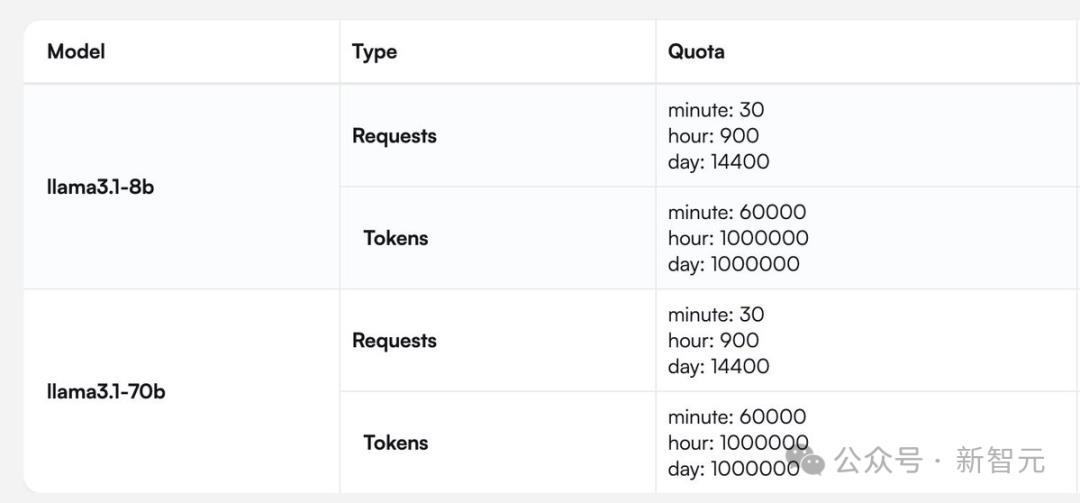

有开发者问道,你们提供的rpm(每分钟请求次数)和tpm(每分钟处理token数)是多少?

Cerebras提供了一张针对Llama 3.1 8B和70B模型完整的请求/token处理数的图。

快速推理,不只为速度

最后,让我们来聊聊,为什么快速推理非常重要?

通常,LLM会即刻输出自己的全部想法,而不考虑最佳答案。而诸如scaffolding(脚手架)这类的新技术,则如同一个深思熟虑的智能体,会在作出决定前探索不同的可能解决方案。

这种「先思考后发言」的方式在代码生成等严苛任务中,可以带来超过10倍的性能提升,从根本上提升了AI模型的智能,且无需额外训练。

但这些技术在运行时,需要多达100倍的token。

因此可见,如果我们能大幅缩短处理时间,那么就可以实现更为复杂的AI工作流程,进而实时增强LLM的智能。

速度爆表,但上下文只有8K

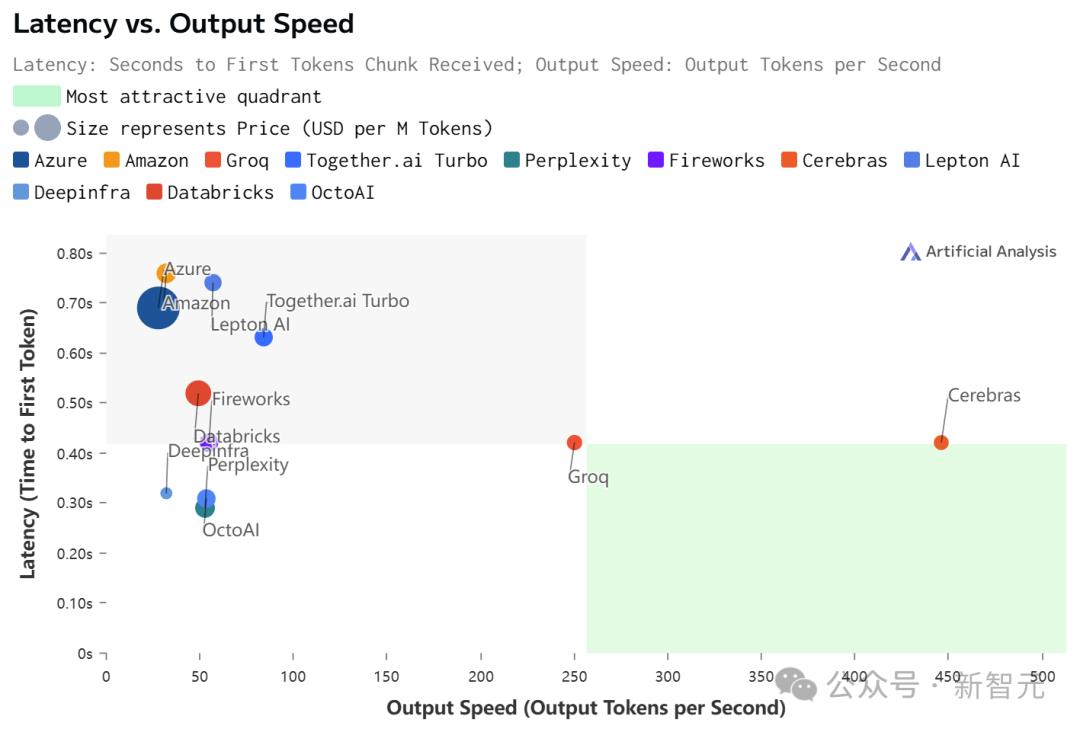

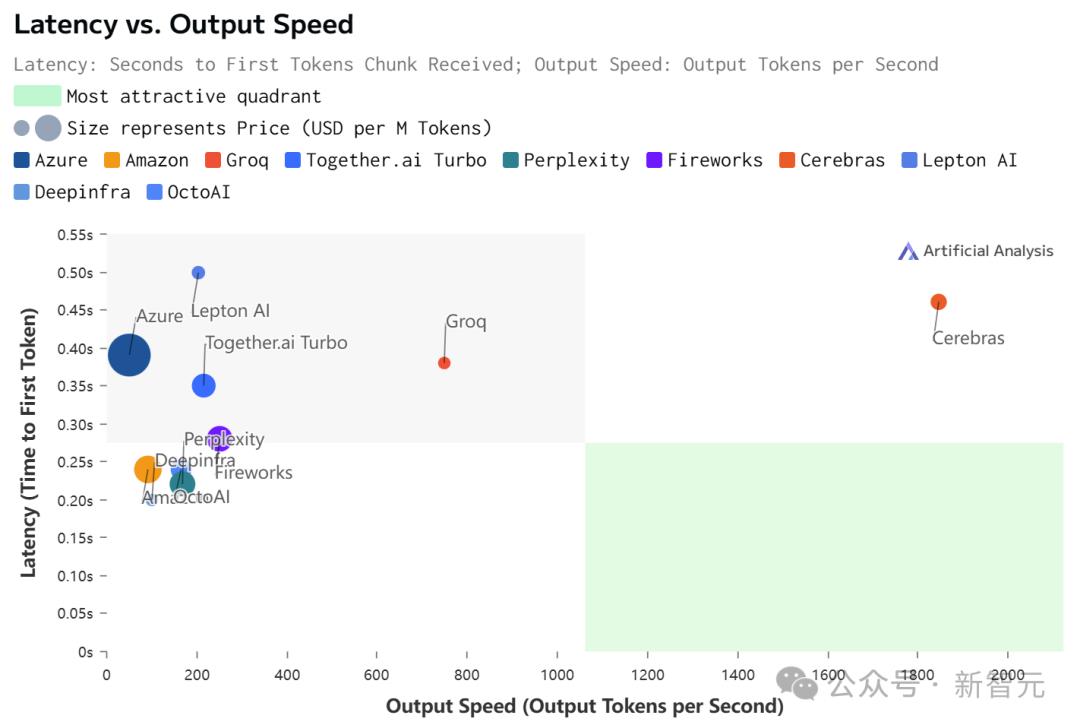

虽然在价格和延迟上,Cerebras都不是最低的。

但极致的速度,确实为Cerebras带来了极致的速度-价格和速度-延迟比。

不过,值得注意的是,在Cerebras上跑的Llama 3.1,上下文只有8k……

相比之下,其他平台都是128K。

具体数据如下:

Llama 3.1 70B

Llama 3.1 8B

参考资料:

https://cerebras.ai/blog/introducing-cerebras-inference-ai-at-instant-speed

https://x.com/CerebrasSystems/status/1828464491677524311

https://artificialanalysis.ai/models/llama-3-1-instruct-70b/providers

大家都在看

-

全球最大车展在顺义启幕,181台新车首发! 4月24日备受全球瞩目的2026(第十九届)北京国际汽车展览会在中国国际展览中心(顺义馆)和首都国际会展中心启幕本届车展以“领时代·智未来”为主题,首次实现中国国际展览中心(顺义馆)与首都国际会展中心双馆联 ... 世界最大04-28

-

世界上最大的9个国家,4个都和新疆有关 我经常想,什么叫“大国中枢”、“亚欧心脏”?咱们国家的新疆维吾尔自治区就是。怎么看?世界上领土面积前9名的国家中,竟然有4个跟新疆有关系,其中包括:世界版图第1大国——俄罗斯,新疆北部与之相连;世界版图 ... 世界最大04-28

-

视频丨美国最大集装箱港口负责人:世界比任何时候都更需要广交会 来源:央视新闻客户端本届广交会汇聚全球各地客商,既有长期携手的老客户,也有初次结缘的新伙伴。今天聚焦一位首次到访广交会的新客人,美国洛杉矶港务局局长金承珂。初次到访,他有何感受?又在广交会的现场有了哪 ... 世界最大04-26

-

美国最大集装箱港口负责人:世界比任何时候都更需要广交会 本届广交会汇聚全球各地客商,既有长期携手的老客户,也有初次结缘的新伙伴。今天聚焦一位首次到访广交会的新客人,美国洛杉矶港务局局长金承珂。初次到访,他有何感受?又在广交会的现场有了哪些收获?洛杉矶港务局 ... 世界最大04-26

-

重达7530吨!全球单机容量最大,开始安装 ◎ 科技日报记者 龙跃梅 通讯员 黄志锋 4月25日,全球单机容量最大的16兆瓦漂浮式海上风电平台“三峡领航号”,在广东阳江青洲海上风电场水域正式开始安装。这标志着我国首个大容量漂浮式海上风电科研示范工程的关键 ... 世界最大04-26

-

耗资1600亿,填了1.2万亩的海!中国造出了世界最大的人工岛 说起世界级奢华海岛,你还只知道迪拜棕榈岛?这座耗资140亿美元的人工岛,曾被捧为“世界第八大奇迹”,是无数人心中的度假天花板。但今天,中国直接甩出王炸!耗时12年、斥资1600亿、填海1.2万亩,硬生生在南海造出 ... 世界最大04-25

-

尤斯特:西甲作为世界顶级联赛之一,现有VAR判罚体系漏洞明显 直播吧4月23日讯 近日,巴萨代理主席拉法·尤斯特接受了《每日体育报》的采访,他谈到了亚马尔的伤病,并对裁判的判罚表达了强烈不满。谈及亚马尔的伤病问题“亚马尔的缺阵影响重大,但我完全相信全队能够顶住压力渡 ... 世界最大04-25

-

世界上最大的鸟类,鸵鸟都没有它大,堪比传说中的鲲鹏 世界上最大的鸟类鸵鸟都没有它大,堪比传说中的鲲鹏。大家知道生活的天空或者掌控天空的动物其实就是飞行,而很多鸟类的体型因为大自然的变化陷入进化的,体型越来越小,而最大的鸟类可能就是陆地上的鸵鸟了。但是要 ... 世界最大04-23

-

从4000平方公里萎缩到35,世界最大冰山死亡花了40年 丨环境小喇叭 大家好,这里是环境小喇叭栏目的第58期。这一期,我们为大家搜罗了以下值得一看的环境研究和新闻:1)世界上最大的冰山消失了2)在冰岛,人们为冰川举行葬礼3)超级厄尔尼诺现象可能在今年夏天出现4)冬季高浓度的抗 ... 世界最大04-23

相关文章

- 世界上最大的鸟类,鸵鸟都没有它大,堪比传说中的鲲鹏

- 全球最大避孕套生产商涨价20-30%,因伊朗战争导致供应链紧张

- 从4000平方公里萎缩到35,世界最大冰山死亡花了40年 丨环境小喇叭

- 全球最大冰山A23a没了,来自地球的警示→

- 全球最大冰山消失!地球已经拉响警报→

- 全球最大生产国,中国玻璃如何实现跨越式发展

- 科学圆桌会丨极地专家谈世界最大冰山崩解:这是一个严肃的提醒

- 世界最大冰山“销号”,南极开始有点绿

- 极地专家谈世界最大冰山崩解:这是一个严肃的提醒

- 带你看世界上最大的东西!

- 千余名建设者奋战冲刺!世界最大跨度公铁两用无砟轨道斜拉桥合龙在即

- 世界最大的岛一马来群岛

- 全球首个最高、最大的6米超仿真人形机器人亮相亦庄半马,跑友争相合影成打卡地标

- 世界上最大的岛屿:格陵兰岛

- 180转/分钟!中国发布,全球最大

- 全球最大、重大跨越 本周我国多领域解锁新成就

- 吉尼斯世界纪录认证!全球最大零食店“零食王国”今日开业

- 世界最大清洁能源走廊一季度补水超203亿立方米

- 美国持续萎缩,中国快速崛起,有望2030年前成全球最大旅游经济体

- 世界最大清洁能源走廊一季度安全高效运行

热门阅读

-

泷泽萝拉作品,光看一眼就让人欲罢不能 07-14

-

高岗事件真相令人震惊 究竟有何隐秘内幕 07-14

-

北京大裤衩 也就是中央电视台总部大楼 10-24

-

江户四十八手 看一看可以年轻十岁 11-01

-

柳州莫菁视频流出,最终判定是男友所为触及法律底线 11-14

-

揭秘翁帆怀孕真相 杨振宁和翁帆的孩子 11-15

-

世界上最大的火车站,在中国(100个足球场大) 05-26